生成AIのセキュリティ対策とは?〜ビジネスと社会を守る安全な利用方法とは?〜生成AIの進化とリスク、安全な活用方法を徹底解説

生成AI革命!業務効率化の鍵を握る一方、情報漏洩、誤情報拡散、サイバー攻撃など、見過ごせないセキュリティリスクも。ChatGPT、StableDiffusionなどの進化と活用事例に加え、企業が直面するリスク、対策、そして倫理的利用の重要性を解説。安全な利用環境構築に向け、企業が取り組むべき対策とは?AIの未来を拓くための、今、必要な情報がここに。

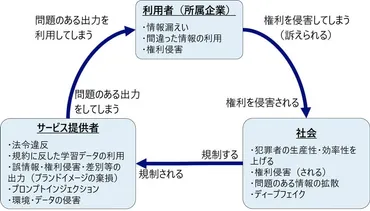

リスク所有者と課題:多角的な視点

生成AIのリスク、誰が直面?利用・提供・社会、それぞれの課題は?

利用者、サービス提供者、社会が、それぞれ異なるリスクに直面。

生成AIのリスクは、利用者、サービス提供者、社会全体に及びます。

多角的な視点から、それぞれの課題を理解することが重要です。

✅ 生成AIのリスクは、利用者、サービス提供者、社会の3つのカテゴリに分類され、相互に関連し合っている。

✅ 利用者としてのリスクには、情報漏えい、誤情報の利用、権利侵害などがあり、企業は従業員の生成AI利用における情報リテラシー不足によるリスクに注意する必要がある。

✅ サービス提供者のリスクには法令違反、権利侵害、ブランドイメージの棄損などがあり、社会全体のリスクには犯罪や情報拡散、ディープフェイクなどが含まれる。

さらに読む ⇒情報セキュリティのNRIセキュア出典/画像元: https://www.nri-secure.co.jp/blog/generative-ai-risks生成AIには多様なリスクが存在します。

利用者は情報リテラシーの向上を、サービス提供者は倫理的利用を推進することが不可欠ですね。

生成AIには、利用者、サービス提供者、社会という3つの主要なリスク所有者が存在し、それぞれが独自の課題に直面しています。

利用者は、情報漏えいや誤情報の利用、権利侵害といったリスクに直面し、特に情報リテラシーの低い従業員が問題となる可能性があります。

サービス提供者は、法令違反、規約違反、ブランドイメージの毀損、プロンプトインジェクションによる環境やデータの侵害などのリスクに直面しており、社会的な信頼を確立するために積極的な対策が求められます。

社会全体としては、権利侵害や犯罪への加担、誤情報や偏見の拡散、ディープフェイクといった問題が懸念されています。

これらのリスクは相互に関連し合い、サービス提供者は社会の変化に対応し、倫理的な利用を推進する必要があります。

難しいことはよく分かんないけど、変な情報に騙されたり、個人情報が漏れたりするのは嫌だよね。みんなが安心して使えるようにしてほしいわ。

具体的な対策:安全な利用環境の構築

生成AIを安全に使うには?必要な対策を具体的に教えて!

機密情報制限、検証、アクセス制御、セキュリティ強化など。

生成AIを安全に利用するためには、様々な対策が必要です。

多角的な視点から、具体的な対策を見ていきましょう。

公開日:2025/06/25

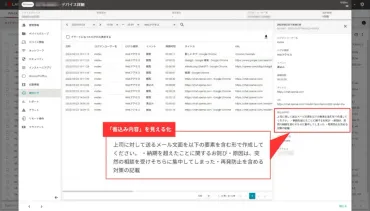

✅ 生成AIの急速な進化とそのビジネス・日常生活への活用の広がりについて解説し、文章作成、画像生成、プログラムコード生成など多岐にわたる能力と業務効率化への期待を示す一方で、セキュリティリスクの顕在化を指摘しています。

✅ 生成AIの基本的な仕組みと活用例を説明し、テキスト生成AI、画像生成AI、音声生成AI、動画生成AI、コード生成AIといった種類と、マーケティング、カスタマーサポート、研究開発、ソフトウェア開発などでの具体的な活用例を紹介しています。

✅ 生成AI特有のセキュリティリスク(プロンプトインジェクション、バイアス、著作権侵害、機密情報の露呈など)を説明し、従来のセキュリティ対策では対応しきれない点を指摘し、生成AIを安全に利用するための対策の重要性を強調しています。

さらに読む ⇒LANSCOPE 総合トップ|サイバーセキュリティは、経営課題。出典/画像元: https://www.lanscope.jp/blogs/it_asset_management_emcloud_blog/20250625_27928/機密情報の入力制限、適切なアクセス制御、セキュリティ対策の強化など、具体的な対策が重要ですね。

企業は、積極的に対策を講じるべきです。

生成AIを安全に利用するためには、多角的な対策が必要です。

機密情報の入力制限、出力結果の検証、適切なアクセス制御、セキュリティ対策の強化、AI倫理ガイドラインの策定などが重要です。

具体的には、データの暗号化、アクセス制限による情報漏洩対策、プロンプトインジェクション対策、定期的な脆弱性診断、情報セキュリティポリシーの遵守などが求められます。

企業は、生成AIの利用を禁止したり、ガイドラインを提供したりして、リスクを軽減しようと努めています。

AIを活用した防御策の重要性が増しており、LANSCOPEサイバープロテクションのようなツールも有効です。

セキュリティ対策は、投資だ!AIを最大限に活用するためには、安全な環境を整えることが不可欠だ!

未来への展望:AIと共存するためのセキュリティ意識

生成AI利用のリスク、企業はどう対応すべき?

リスク管理、安全な利用環境構築、社内ルール策定!

生成AIの未来を見据え、セキュリティ意識を高めることが重要です。

AIと共存し、そのメリットを最大限に活かすために、私たちは何をすべきでしょうか。

✅ 生成AIはビジネスの効率化に役立つ一方で、情報漏洩や誤情報拡散といったセキュリティリスクが懸念されています。

✅ 生成AIは、テキスト作成、チャットボット、データ分析、画像・動画生成など、多様なビジネスシーンで活用されています。

✅ 生成AIの安全性を確保し、リスクを管理するためには、情報漏洩対策や誤情報への注意、プロンプトの管理などが重要です。

さらに読む ⇒株式会社ソフトクリエイト出典/画像元: https://www.softcreate.co.jp/safeai/ai-tips/16生成AIの進化と共に、セキュリティリスクも変化していきます。

企業は、AIの倫理的利用と安全な利用環境の構築に積極的に取り組む必要がありますね。

生成AIの進化と業務利用の拡大に伴い、セキュリティリスクは今後も顕在化することが予想されます。

従来のセキュリティ対策だけでは対応できないAIモデルの挙動やインタラクションに起因するリスクへの対策が不可欠です。

企業は、生成AIのメリットを最大限に活かすために、これらのリスクを適切に管理し、安全な利用環境を構築する必要があります。

MOTEXが公開しているAIサービス利用ガイドラインなどを参考に、社内ルールを策定し、セキュリティ教育を徹底することも重要です。

生成AIは、私たちの生活やビジネスを大きく変える可能性を秘めており、AIの倫理的利用と安全な利用環境の構築は、未来社会の鍵となります。

AIは、まるで人間のようで怖いけど、可能性も無限大。ちゃんと対策して、みんなでAIと仲良く暮らせるようにしなきゃね!

本日は、生成AIのセキュリティリスクと対策について、分かりやすく解説しました。

AIの進化は止まりません。

今後も情報収集を怠らず、安全な利用を心がけましょう。

💡 生成AIのビジネス活用は加速していますが、情報漏洩や誤情報拡散などのリスクも顕在化しています。

💡 安全な生成AIの利用には、情報セキュリティ対策、AI倫理ガイドラインの策定、AIを活用した防御策が重要です。

💡 企業は、生成AIのメリットを最大限に活かすために、リスクを適切に管理し、安全な利用環境を構築する必要があります。